2024-07-14

Innovation Highlights

高阳团队提出了策略学习的任意点轨迹模型 (Any-point Trajectory Modeling,ATM),通过预训练轨迹模型来预测视频帧内任意点的未来轨迹,从而利用视频为机器人提供演示。训练完成后,这些轨迹将提供详细的控制指导,实现小样本动作标签演示数据训练鲁棒的机器人操作策略。

Achievements Summary

在机器学习领域,从视频中提取特定的控制信息非常具有挑战性。现有利用视频学习策略的工作都是基于图像级别的视频生成,这不仅计算成本高,而且生成结果较差。

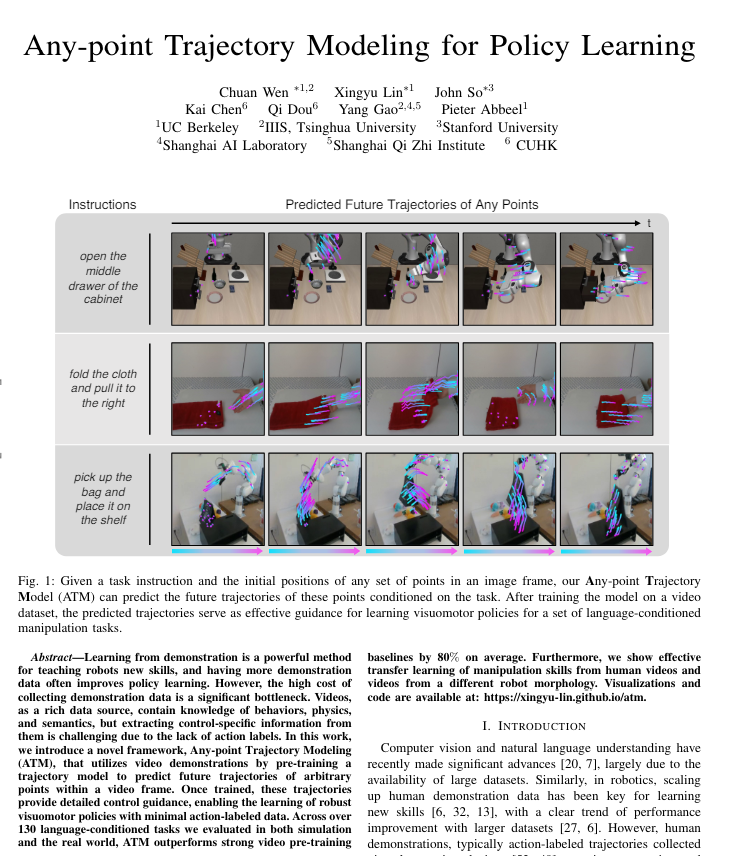

针对这一问题,高阳研究组提出任意点轨迹建模(ATM),通过预训练轨迹模型来预测视频帧内任意点的未来轨迹,实现通过视频为机器人提供演示。与图像生成相比,点能自然地捕捉到物体空间移动的归纳偏差,并将物体运动与色彩和纹理分离开来,实现从人类到机械臂的跨具身一致性匹配。通过这些学习到的轨迹作为指导,机器人可以利用大规模无动作标签的人类视频演示中蕴含的先验知识,实现小样本动作标签演示数据训练鲁棒的机器人操作策略。

如视频中的真实机械臂操作实验所示,ATM利用大量人类视频训练点轨迹预测模型(第一行),经过极少量样本微调后可以成功泛化到机械臂运动控制任务上(第二行),成功解决可变形物体、多步任务和工具使用等困难的机械臂操作场景。视频中所预测轨迹的起始点为蓝色,终止点为粉色。

研究组在仿真器和真实世界机器人实验中均对该算法进行了评估,在超过 130 项以自然语言为条件的机器人操作任务中,性能显著超过现有最优视频预训练基线80%。此外,该工作还展示了从人类视频向机械臂操作的真机跨具身迁移学习效果。该工作获得了全体审稿人满分评价。本论文共同第一作者为上海期智研究院实习生、清华大学交叉信息研究院博士生汶川,加州大学伯克利分校博后林星宇,斯坦福大学硕士生John So。